쿠버네티스 Pod CrashLoopBackOff 완벽 해결 가이드

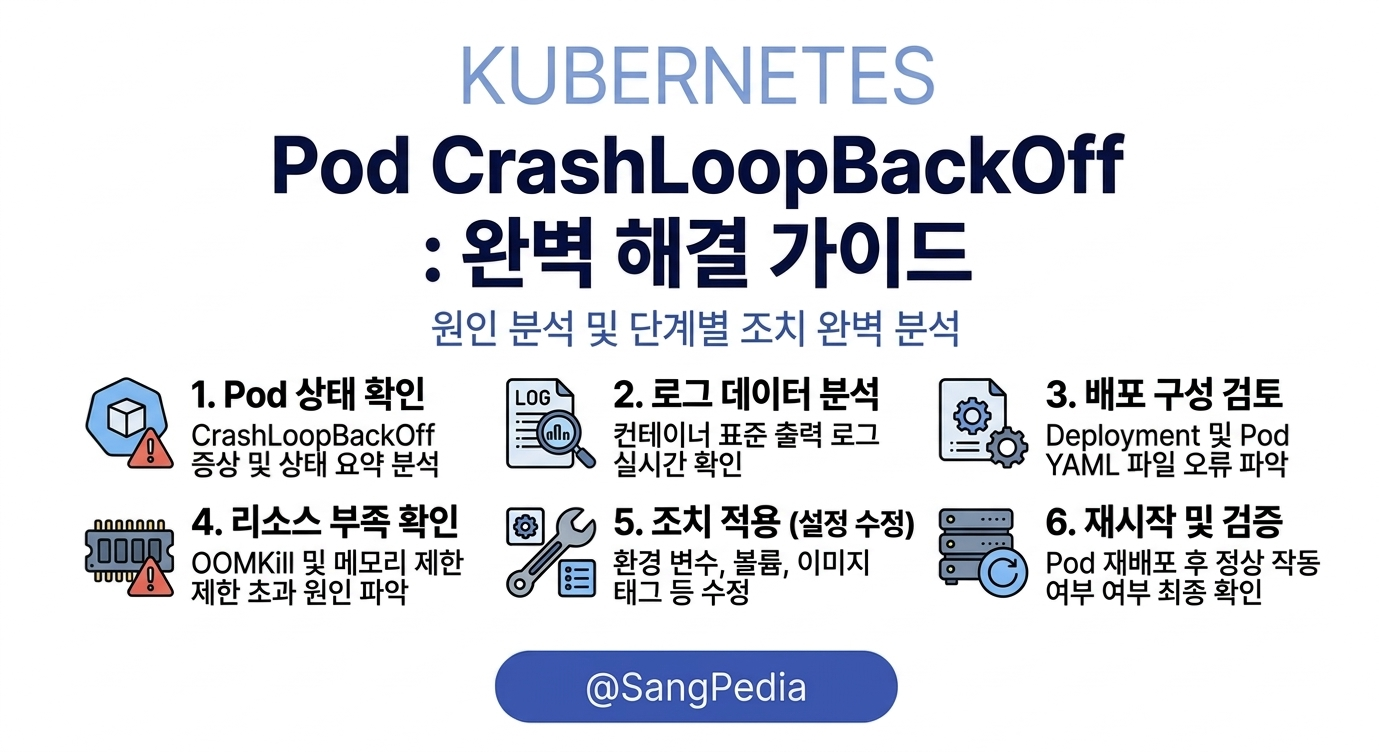

쿠버네티스 환경에서 Pod가 CrashLoopBackOff 상태에 빠지는 것은 흔한 문제 중 하나입니다. 이 상태는 Pod가 계속해서 시작하고 종료되는 것을 반복하며, 서비스의 안정성을 저해합니다. 이 글에서는 CrashLoopBackOff의 원인을 분석하고, 단계별 해결 방법을 제시하며, 예방 조치와 자주 묻는 질문(FAQ)을 통해 문제 해결을 돕겠습니다.

목차

에러 현상

CrashLoopBackOff 상태는 kubectl get pods 명령어를 통해 확인할 수 있습니다. 다음은 예시 출력입니다.

NAME READY STATUS RESTARTS AGE

my-app-pod-7c78f55d5f-9qqrm 0/1 CrashLoopBackOff 5 2m

위 출력에서 STATUS 열이 CrashLoopBackOff로 표시되어 있으며, RESTARTS 열은 Pod가 재시작된 횟수를 나타냅니다. 이 상태는 Pod가 정상적으로 실행되지 못하고 계속 재시작을 시도하고 있음을 의미합니다.

원인 분석

CrashLoopBackOff 상태의 원인은 다양하지만, 가장 흔한 원인 3가지는 다음과 같습니다.

1. 애플리케이션 오류 또는 예외

컨테이너 내부에서 실행되는 애플리케이션이 예외를 발생시키거나, 예상치 못한 오류로 인해 종료되는 경우 CrashLoopBackOff가 발생할 수 있습니다. 이는 코드의 버그, 잘못된 설정, 또는 외부 의존성 문제로 인해 발생할 수 있습니다. 예를 들어, 데이터베이스 연결에 실패하거나, 필요한 파일을 찾을 수 없는 경우 애플리케이션이 비정상적으로 종료될 수 있습니다.

2. 리소스 부족 (메모리, CPU)

Pod에 할당된 메모리나 CPU가 부족한 경우, 애플리케이션이 정상적으로 실행되지 못하고 강제 종료될 수 있습니다. 특히, Java 애플리케이션과 같이 메모리를 많이 사용하는 애플리케이션에서 흔히 발생합니다. 쿠버네티스는 Pod에 할당된 리소스 제한을 초과하면 OOMKilled (Out Of Memory Killed) 이벤트를 발생시키고, Pod를 재시작합니다.

3. 잘못된 이미지 태그 또는 존재하지 않는 이미지

디플로이먼트 또는 Pod 정의에 지정된 컨테이너 이미지 태그가 잘못되었거나, 해당 이미지가 레지스트리에 존재하지 않는 경우 CrashLoopBackOff가 발생할 수 있습니다. 예를 들어, latest 태그를 사용했는데, 해당 이미지가 업데이트되지 않았거나, 이미지 이름에 오타가 있는 경우 Pod는 이미지를 가져오는 데 실패하고, 계속해서 재시작을 시도합니다.

해결 방법

각 원인에 따른 해결 방법은 다음과 같습니다.

1. 애플리케이션 오류 또는 예외

- 문제 진단:

kubectl logs <pod-name>명령어를 사용하여 Pod의 로그를 확인합니다. 로그에서 오류 메시지나 예외 스택 트레이스를 찾아 애플리케이션의 문제점을 파악합니다. bash kubectl logs my-app-pod-7c78f55d5f-9qqrm- 문제 해결: 로그 분석을 통해 발견된 문제점을 해결합니다. 코드 수정, 설정 변경, 또는 외부 의존성 업데이트 등이 필요할 수 있습니다.

- 배포: 수정된 코드를 빌드하고, 새로운 컨테이너 이미지를 생성하여 레지스트리에 푸시합니다.

- 적용:

kubectl apply -f <deployment-file.yaml>명령어를 사용하여 변경 사항을 쿠버네티스 클러스터에 적용합니다. bash kubectl apply -f deployment.yaml- 확인: Pod가 정상적으로 실행되는지 확인합니다.

kubectl get pods명령어를 사용하여 Pod의 상태를 확인하고,kubectl logs <pod-name>명령어를 사용하여 로그를 다시 확인합니다.

2. 리소스 부족 (메모리, CPU)

- 문제 진단:

kubectl describe pod <pod-name>명령어를 사용하여 Pod의 이벤트 로그를 확인합니다.OOMKilled이벤트가 있는지 확인하여 메모리 부족 여부를 판단합니다. bash kubectl describe pod my-app-pod-7c78f55d5f-9qqrm- 리소스 요청 및 제한 조정: 디플로이먼트 또는 Pod 정의 파일에서 리소스 요청(

resources.requests) 및 제한(resources.limits)을 조정합니다. 메모리 또는 CPU 요청량을 늘려 Pod가 필요한 리소스를 확보할 수 있도록 합니다. yaml apiVersion: apps/v1 kind: Deployment metadata: name: my-app-deployment spec: replicas: 1 selector: matchLabels: app: my-app template: metadata: labels: app: my-app spec: containers: - name: my-app-container image: contoso.com/my-app:latest resources: requests: memory: "512Mi" cpu: "250m" limits: memory: "1Gi" cpu: "500m"- 적용:

kubectl apply -f <deployment-file.yaml>명령어를 사용하여 변경 사항을 쿠버네티스 클러스터에 적용합니다. - 확인: Pod가 정상적으로 실행되는지 확인합니다.

kubectl get pods명령어를 사용하여 Pod의 상태를 확인하고,kubectl describe pod <pod-name>명령어를 사용하여 이벤트 로그를 다시 확인합니다.

3. 잘못된 이미지 태그 또는 존재하지 않는 이미지

- 문제 진단:

kubectl describe pod <pod-name>명령어를 사용하여 Pod의 이벤트 로그를 확인합니다. 이미지를 가져오는 데 실패했다는 오류 메시지가 있는지 확인합니다. - 이미지 태그 확인 및 수정: 디플로이먼트 또는 Pod 정의 파일에서 컨테이너 이미지 태그를 확인하고, 올바른 태그를 사용하고 있는지 확인합니다. 이미지 이름에 오타가 없는지 확인합니다.

- 이미지 존재 여부 확인: 컨테이너 레지스트리에서 해당 이미지가 존재하는지 확인합니다. 이미지가 존재하지 않는 경우, 올바른 이미지를 빌드하고 레지스트리에 푸시합니다.

- 적용:

kubectl apply -f <deployment-file.yaml>명령어를 사용하여 변경 사항을 쿠버네티스 클러스터에 적용합니다. - 확인: Pod가 정상적으로 실행되는지 확인합니다.

kubectl get pods명령어를 사용하여 Pod의 상태를 확인합니다.

예방 조치

CrashLoopBackOff 상태를 예방하기 위해서는 다음과 같은 조치를 취할 수 있습니다.

- 애플리케이션 로깅 강화: 애플리케이션의 로깅 수준을 높여 오류 발생 시 디버깅에 필요한 정보를 충분히 확보합니다.

- 리소스 모니터링: Prometheus와 Grafana와 같은 도구를 사용하여 Pod의 CPU, 메모리 사용량을 지속적으로 모니터링하고, 리소스 부족이 예상되는 경우 알림을 받도록 설정합니다.

yaml apiVersion: monitoring.coreos.com/v1 kind: PodMonitor metadata: name: my-app-pod-monitor namespace: monitoring spec: selector: matchLabels: app: my-app namespaceSelector: matchNames: - default podMetricsEndpoints: - port: metrics interval: 30s- Liveness Probe 및 Readiness Probe 설정: Liveness Probe를 사용하여 애플리케이션이 살아 있는지 주기적으로 확인하고, Readiness Probe를 사용하여 애플리케이션이 트래픽을 처리할 준비가 되었는지 확인합니다. 이를 통해 Pod가 비정상적인 상태에 빠졌을 때 자동으로 재시작되도록 설정할 수 있습니다.

yaml apiVersion: apps/v1 kind: Deployment metadata: name: my-app-deployment spec: # ... (기존 설정) ... template: spec: containers: - name: my-app-container # ... (기존 설정) ... livenessProbe: httpGet: path: /healthz port: 8080 initialDelaySeconds: 30 periodSeconds: 10 readinessProbe: httpGet: path: /readyz port: 8080 initialDelaySeconds: 15 periodSeconds: 5- 자동화된 배포 파이프라인: CI/CD 파이프라인을 구축하여 코드 변경 사항을 자동으로 빌드, 테스트, 배포합니다. 이를 통해 휴먼 에러를 줄이고, 배포 과정을 더욱 안정적으로 관리할 수 있습니다.

FAQ

Q: CrashLoopBackOff 상태는 무엇을 의미하나요?

A: CrashLoopBackOff는 쿠버네티스 Pod가 시작에 실패하고, 계속해서 재시작을 시도하는 상태를 의미합니다. 이는 컨테이너 내부의 애플리케이션이 예기치 않게 종료되거나, 시작 스크립트에서 오류가 발생하는 경우, 또는 컨테이너가 필요한 리소스를 확보하지 못하는 경우 등에 발생할 수 있습니다. 이 상태가 지속되면 서비스 불안정으로 이어질 수 있으므로 신속한 원인 파악과 해결이 중요합니다.

Q: kubectl describe pod 명령어로 어떤 정보를 얻을 수 있나요?

A: kubectl describe pod 명령어는 특정 Pod에 대한 상세 정보를 제공합니다. 이 정보에는 Pod의 상태, 이벤트 로그, 컨테이너 이미지 정보, 리소스 요청/제한, 그리고 Pod가 실패한 경우의 오류 메시지 등이 포함됩니다. CrashLoopBackOff 상태의 Pod를 진단할 때, 이 명령어를 사용하여 이벤트 로그를 확인하면 컨테이너가 왜 실패했는지에 대한 단서를 찾을 수 있습니다. 예를 들어, OOMKilled 이벤트는 메모리 부족으로 인해 컨테이너가 종료되었음을 나타냅니다.

Q: CrashLoopBackOff를 예방하기 위한 모니터링 방법은 무엇인가요?

A: CrashLoopBackOff를 예방하기 위해서는 Pod의 상태를 지속적으로 모니터링하고, 비정상적인 상황 발생 시 즉시 알림을 받을 수 있도록 설정하는 것이 중요합니다. Prometheus와 Grafana를 사용하여 Pod의 CPU, 메모리 사용량, 재시작 횟수 등을 모니터링하고, 특정 임계값을 초과할 경우 Slack이나 이메일로 알림을 보내도록 구성할 수 있습니다. 또한, Liveness Probe와 Readiness Probe를 적절히 설정하여 Pod의 상태를 능동적으로 관리하는 것도 중요합니다.

'B2B Solution > 트러블슈팅' 카테고리의 다른 글

| RabbitMQ 연결 오류 완벽 해결 가이드: 원인 분석부터 예방까지 (0) | 2026.03.09 |

|---|---|

| Docker 컨테이너 빌드 실패! 원인 분석 및 해결 가이드 (Dockerfile 오류, 권한 문제) (0) | 2026.03.07 |

| SSH 접속 시 "Permission denied" 에러 완벽 해결 가이드 (원인 분석 & 단계별 조치) (0) | 2026.03.05 |

| Nginx 502 Bad Gateway 오류 해결: 원인 분석 및 단계별 해결 가이드 (0) | 2026.03.05 |

| SSL 인증서 오류 해결 가이드: IT 관리자를 위한 완벽 분석 및 해결책 (0) | 2026.03.02 |