Apache Airflow 데이터 파이프라인 구축

Apache Airflow란?

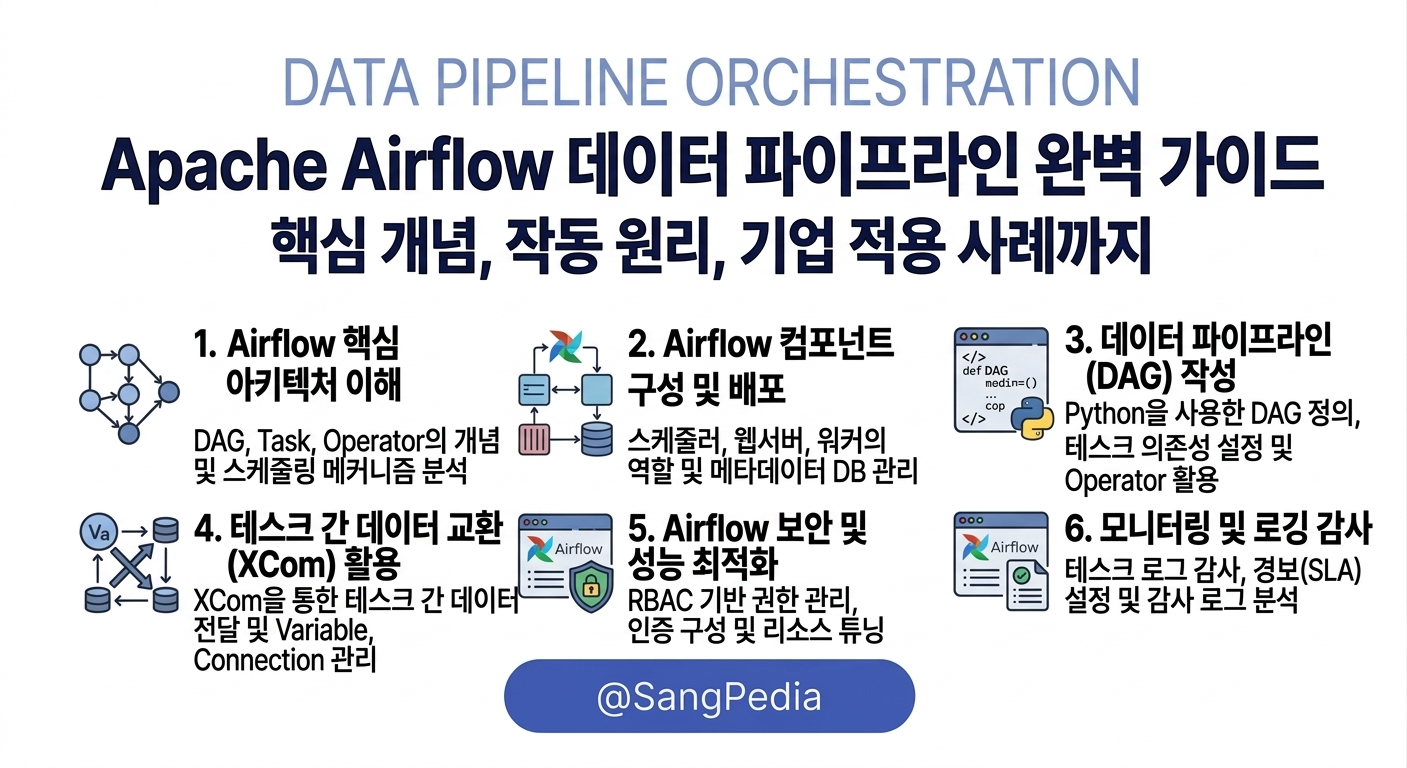

Apache Airflow는 워크플로우를 프로그래밍 방식으로 작성, 스케줄링, 모니터링할 수 있는 오픈 소스 플랫폼입니다. 복잡한 데이터 파이프라인을 효율적으로 관리하고 자동화하는 데 필수적인 도구이며, 데이터 엔지니어링 및 데이터 과학 분야에서 널리 사용됩니다. Airflow는 DAG(Directed Acyclic Graph)라는 개념을 사용하여 워크플로우를 정의하고, 각 Task 간의 의존성을 명확하게 표현할 수 있도록 합니다.

작동 원리

Apache Airflow는 다음과 같은 단계로 데이터 파이프라인을 실행합니다.

-

DAG 정의: 파이썬 코드를 사용하여 DAG를 정의합니다. DAG는 Task들의 집합이며, 각 Task는 수행해야 할 작업의 단위를 나타냅니다. Task 간의 의존성을 정의하여 실행 순서를 결정합니다. Airflow는 DAG 파일을 파싱하여 워크플로우 구조를 식별합니다.

-

스케줄링: DAG에 정의된

schedule_interval에 따라 워크플로우 실행을 스케줄링합니다. Cron 표현식 또는 미리 정의된 간격(예:@daily,@weekly)을 사용하여 실행 주기를 설정할 수 있습니다. -

Task 실행: 스케줄러는 정의된 시간에 따라 DAG 내의 Task를 실행합니다. Task는 Operator를 사용하여 실제 작업을 수행합니다. 예를 들어,

BashOperator는 셸 명령을 실행하고,PythonOperator는 파이썬 함수를 실행합니다. -

의존성 관리: Airflow는 Task 간의 의존성을 관리하여, 선행 Task가 성공적으로 완료된 후에만 후행 Task를 실행합니다. 의존성 관리는 데이터의 정확성과 일관성을 유지하는 데 중요한 역할을 합니다.

-

모니터링: Airflow UI를 통해 DAG 및 Task의 실행 상태를 실시간으로 모니터링할 수 있습니다. 로그, 실행 시간, 성공/실패 여부 등을 확인하여 문제 발생 시 신속하게 대응할 수 있습니다.

Task 정의 예시

from airflow import DAG

from airflow.operators.bash_operator import BashOperator

from datetime import datetime

with DAG('my_dag', start_date=datetime(2023, 1, 1), schedule_interval='@daily') as dag:

task1 = BashOperator(

task_id='print_date',

bash_command='date'

)

task2 = BashOperator(

task_id='sleep',

bash_command='sleep 5'

)

task1 >> task2 # Task 의존성 설정

기업 환경 적용 사례

-

데이터 웨어하우스 ETL: Airflow를 사용하여 데이터 웨어하우스로 데이터를 추출, 변환, 적재(ETL)하는 파이프라인을 구축할 수 있습니다. 예를 들어, 매일 자정마다 여러 데이터 소스에서 데이터를 추출하여 정제하고, Amazon Redshift 또는 Snowflake에 적재하는 워크플로우를 자동화할 수 있습니다.

-

머신러닝 모델 학습: Airflow를 사용하여 머신러닝 모델을 학습하고 배포하는 파이프라인을 구축할 수 있습니다. 예를 들어, 매주 월요일마다 최신 데이터를 사용하여 모델을 재학습하고, 학습된 모델을 프로덕션 환경에 배포하는 워크플로우를 자동화할 수 있습니다.

-

Azure Data Factory 연동: Airflow를 사용하여 Azure Data Factory 파이프라인을 트리거하고 모니터링할 수 있습니다. 이를 통해 클라우드 기반 데이터 통합 서비스를 활용하면서, Airflow의 강력한 스케줄링 및 모니터링 기능을 함께 사용할 수 있습니다. contoso.com에서는 Azure Data Factory와 Airflow를 연동하여 하이브리드 데이터 파이프라인을 구축하고 있습니다.

장점과 한계

| 장점 | 설명 |

|---|---|

| 유연성 및 확장성 | 다양한 Operator를 제공하며, 필요에 따라 커스텀 Operator를 개발하여 사용할 수 있습니다. |

| 코드형 인프라 (Infrastructure as Code) | 파이썬 코드를 사용하여 워크플로우를 정의하므로, 버전 관리 및 협업이 용이합니다. |

| 강력한 스케줄링 기능 | Cron 표현식 또는 미리 정의된 간격을 사용하여 복잡한 스케줄링 요구 사항을 충족할 수 있습니다. |

| 풍부한 모니터링 기능 | Airflow UI를 통해 DAG 및 Task의 실행 상태를 실시간으로 모니터링하고, 문제 발생 시 알림을 받을 수 있습니다. Airflow 모니터링은 데이터 파이프라인 운영의 핵심 요소입니다. |

| 활발한 커뮤니티 지원 | 오픈 소스 프로젝트로서 활발한 커뮤니티 지원을 받을 수 있으며, 다양한 플러그인 및 통합 기능이 제공됩니다. |

| 한계 | 설명 |

| 러닝 커브 | Airflow의 개념 및 사용법을 익히는 데 시간이 소요될 수 있습니다. 특히, DAG 작성 및 Operator 사용에 대한 이해가 필요합니다. |

| 복잡한 DAG 관리 | DAG가 복잡해질수록 관리 및 유지 보수가 어려워질 수 있습니다. 적절한 DAG 설계 및 코드 관리가 중요합니다. |

| 인프라 관리 | Airflow를 실행하기 위한 인프라(예: 데이터베이스, 워커 노드)를 직접 관리해야 합니다. 클라우드 기반 Airflow 서비스(예: Amazon MWAA, Google Cloud Composer)를 사용하면 인프라 관리 부담을 줄일 수 있습니다. |

| 동적 DAG 생성의 어려움 | 런타임에 DAG 구조를 동적으로 변경하는 것이 제한적입니다. |

| Task 간 데이터 공유의 복잡성 | Task 간에 대용량 데이터를 효율적으로 공유하는 것이 어려울 수 있습니다. 외부 저장소(예: Amazon S3, Google Cloud Storage)를 사용하여 데이터를 공유하는 것이 일반적입니다. |

FAQ

위의 FAQ는 faq_schema에 포함되어 있습니다.

'B2B Solution' 카테고리의 다른 글

| 2026년 AWS SAA 자격증 완벽 가이드: 합격 전략, 준비 방법, 시험 꿀팁 총정리 (0) | 2026.03.27 |

|---|---|

| AWS 비용 최적화 완벽 가이드: 핵심 전략, 실전 사례, FAQ 총정리 (0) | 2026.03.27 |

| 성공적인 클라우드 마이그레이션을 위한 완벽 체크리스트 (0) | 2026.03.25 |

| 쿠버네티스 CKA 자격증 완벽 가이드: 준비 방법, 시험 정보, 합격 전략 총정리 (0) | 2026.03.25 |

| 정보처리기사 실기 합격 가이드: 초보부터 현직자까지 맞춤 전략 (0) | 2026.03.25 |